(CNN) – La política ética de inteligencia artificial actualizada de Google elimina su promesa de que no utilizará la tecnología para buscar aplicaciones en el ámbito de las armas y la vigilancia.

En una versión anterior de los principios que la CNN vio en el archivo de internet Wayback Machine, la empresa incluía aplicaciones que no buscaría. Una de esas categorías era la de armas u otra tecnología destinada a herir a personas. Otra era la de tecnología utilizada para vigilar más allá de las normas internacionales.

Ese texto ha desaparecido de la página de la política actualizada.

Desde que OpenAI lanzó el chatbot ChatGPT en 2022, la carrera de la inteligencia artificial ha avanzado a un ritmo vertiginoso. Si bien la IA ha experimentado un auge en su uso, la legislación y las regulaciones sobre transparencia y ética en IA aún no se han puesto al día, y ahora Google parece haber relajado las restricciones autoimpuestas.

En una publicación de blog el martes, el vicepresidente sénior de investigación, laboratorios, tecnología y sociedad, James Manyika, y el director de Google DeepMind, Demis Hassabis, dijeron que los marcos de IA publicados por países democráticos han profundizado la “comprensión de Google sobre el potencial y los riesgos de la IA”.

“Hay una competencia global en curso por el liderazgo de la IA dentro de un panorama geopolítico cada vez más complejo. Creemos que las democracias deben liderar el desarrollo de la IA, guiadas por valores fundamentales como la libertad, la igualdad y el respeto por los derechos humanos”, decía la publicación del blog.

La publicación continuaba: “y creemos que las empresas, los gobiernos y las organizaciones que comparten estos valores deben trabajar juntos para crear una IA que proteja a las personas, promueva el crecimiento global y respalde la seguridad nacional”.

Google publicó por primera vez sus Principios de IA en 2018, años antes de que la tecnología se volviera casi omnipresente. La actualización de Google supone un cambio radical de los valores de esos principios publicados originalmente.

En 2018, Google abandonó una oferta de 10.000 millones de dólares para un contrato de computación en la nube del Pentágono, diciendo en ese momento que “no podíamos estar seguros de que se alineara con nuestros Principios de IA”. Más de 4.000 empleados habían firmado una petición ese año exigiendo “una política clara que estableciera que ni Google ni sus contratistas construirán nunca tecnología de guerra”, y alrededor de una docena de empleados dimitieron en protesta.

CNN se ha puesto en contacto con Google para pedirle comentarios.

Lo más leído

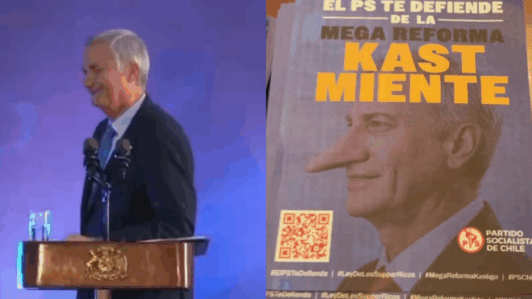

- “Mírenme de perfil, yo me encuentro bastante armónico”: Kast ironiza sobre memes por panfleto del PS y pide apoyo para megarreforma

- Lima lidera el ranking de las mejores ciudades gastronómicas del mundo en 2026 según Time Out

- Créditos hipotecarios siguen a la baja: Tasas anotan su menor nivel desde noviembre de 2021

- Diputado ofició al Ministerio de Justicia por entrega errónea de carnet a extranjeros sin residencia definitiva en Chile

- Sequía récord y despacho de termoeléctricas a diésel dispararon los costos eléctricos en mayo al doble